This paper has object to examine the empirical performance of market risk measurement innew Fundamental Review of the Trading Book (FRTB) regulation. Through an empirical study, we analyze the predictive performance of the Value-at-Risk (VaR) and Expected Shortfall (ES) models by using backtesting procedures for 2007-2012 periods (US subprime Mortgage Crisis and European Sovereign Debt).The applied methodology includes analyzes, synthesis and statistical/econometric methods. The empirical results show a clear outperformance of Expected Shortfall (ES) measuresthanValue-at-Risk (VaR) measures.Another important result is the backtesting procedure recommended by Fundamental Review of the Trading Book (FRTB) regulation penalizes the recommended market risk measurement.

## I. IntroduCtion

a crise financière de 2007-2012a révélé une grande faiblesse des systèmes bancaires et inanciers mondiaux en matière de l'évaluation et la gestion du risque de marché. Elle a mis en exergue les failles structurelles de la régulation bancaire et financière et leurs incapacités de mesurer correctement le risque systémique en période de forte volatilité, pourtant les dispositifs de surveillance du risqué de marchépossé daientplus de dix ans d'expérience après les différents travaux du comité de Bâle et la mise en œuvre généralisée des systèmes de contrôle des risques. Dans cecontexte, les autorités de régulation ont profité de la situation pour renforcer leurs exigences de contrôle, fondées jusque-là sur la «Value at Risk - VaR» et les stress tests. Dans un premier temps, elles ont instauré, en décembre 2011, une série des réformes desméthodes d'évaluation du risque de marché connues sous le nom de Bâle 2.5. La méthodeVaR de Bâle lla été complétée par trois nouvelles mesures du risque de marché: la stressedVaR, l'Incremental Risk Charge (IRC) et la Comprehensive Risk Measure (CRM).Cependant, ces nouvelles mesures ont rendu le texteréglementairemoins cohérentvis-à-visde la mesure globale du risque de marché qui est devenueconfuse et difficile à comprendre. Ensuite, un certain nombre de révisions du cadre réglementaire ont été lancés: quatre études d'impact quantitatives et trois documents consultatifs, dont la version finale, connue sous le nom«Fundamental Review of the Trading Book ou FRTB», a été publiée en janvier 2016 et prévued'entrée en vigueur au 1er janvier 2023, sous réserve d'être adoptée et mise en application par les banques centrales.

La FRTB apporte une refonte complète. Quatre grands axes sont au cœur de cette réforme:

1. Redéfinition, selon des règles strictes, la frontière entre le trading book et le banking booken la rendant plus claire.

2. Introduction d'une nouvelle approche de mesure du risque de marché qui repose non plus sur la VaRet la StressedVaRmais sur le modèle de l'Expected Shortfall (ES). Le recours à l'ES permettra de mieux prendre en compte les pertes extrêmes et les queues de distribution épaisses.

3. Révision de l'approche fondée sur les modèles internes en instaurant son application à l'échelle de chaque desk de tradingplutôt qu'à l'échelle globaleet en renforçantles règles de validation des modèles interne au moyen des procédures dubacktestingavec la possibilité d'introduire des critères supplémentaires.

- 4.Incorporation du risque d'illiquidité du marché.

Dans le cadre de l'évaluation du risque de marché, le FRTB insiste sur l'utilisation de l'ExpectedShortfall (ES) au seuil de $97.5\%$ au lieu de la VaR au seuil de $99\%$. Or, dans un monde gaussien,les deux mesures sont presque équivalentes puisque le quantile de la VaR à $99\%$ est 2.326 et le quantile de l'ExpectedShortfall (ES) à $97.5\%$ est de 2.338. En revanche, pour une distribution des rendements avec des queues plus épaisses qu'une distribution normale, la valeur de l'ExpectedShortfall (ES) peut être considérablement supérieure à la VaR.Dans ce contexte, nous nous intéressons aux modèles d'évaluation du risque de marché ainsi qu'à leurs faiblesses tout en proposant des solutions pratiques permettant de combler leurs insuffisances. En considérant les approches Value-at-Risk (VaR) et ExpectedShortfall (ES) comme les mesures standards du risque de marché pour les autorités de régulation des marchés financiers et pour l'ensemble des institutions financières et bancaires, nous nous interrogeons sur leur efficacité empirique dans la pratique de l'évaluation du risque de marché; un sujet d'actualité qui est devenu particulièrement important dans la conjoncturedescrises financièresoù l'explosion de la volatilité des différentesclasses d'actifs avait tendance à rendre les investisseurs et les autorités de régulation desmarchés financiers averses aux risques.

Dans ce travail, nous nous focalisons sur l'approche paramétrique des méthodes d'évaluation du risque de marché où la volatilitéest un inputcrucial. Nous proposons des modèles d'estimation de la volatilité multivariés capables de reproduire les faitsstylisés exhibés par les changements de prix d'actifs financiers pour mesurer le risque demarché. Plus précisément, nous effectuons une étude empirique comparative en utilisant la spécificationExponentiallyWeighted Moving Average Covariance(EwMA Covariance),le modèle de la Corrélation Conditionnelle Constante (CcC), le modèle de la Corrélation Conditionnelle Dynamique (DCC) et le modèle DCC Asymétrique (ADCC)afind'estimer la VaR et l'ESdumarchépourla période du temps 2000-2012.Le choix de cette période du temps constitue un critère pertinent pour tester la qualité prédictive des mesures du risque de marché. Elle est considérée comme la plus stressante dans l'histoire du capitalisme puisqu'elle intègre la crise dessubprimes2007-2008 et la crise des dettes souveraines 2009-2012.À travers cela, nous cherchons à présenter aux investisseurs, aux risk managers, ouencore aux autorités de régulation des marchés, des outils de mesure du risque, mieuxadaptés à leurs objectifs, afin d'éviter toute sur-estimation et sous-estimation qu'impliquel'emploi des indicateurs de risque usuels. Ensuite, nous testons la qualité prédictive des mesures du risque adoptées au moyen des procédures de backtestingen vue d'examiner leurs performances empiriques dans le cadre de l'évaluation et la gestion du risque de marché. Nous abordons deux méthodes du backtesting: la première repose sur les méthodes de backtestingrecommandée par le régulateur, la deuxième utilise certains tests statistiques.

La suite de ce travail est organisée de la manière suivante: la section 2 fournit une revue de littérature. La section 3 fournit une description des différents modèles de quantification de la VaRet de l'ESet les procédures de backtesting des modèles dont nous cherchons à tester la pertinence. La section 4 présente les résultats de l'étude empirique des différents modèles de mesure du risque de marchéet les résultats dubacktesting.

## II. REvue De LittÉrature

L'examen de la littérature des méthodes d'évaluation du risque de marché par la Value-at-Risk (VaR) et lExpected Shortfall (ES) révèle qu'il y a peu de travaux de recherche empiriques qui ont traité cette problématique. En effet, il existe une littérature abondante sur la VaR qui a fourni plusieurs méthodes d'évaluation de la VaR (Giot & Laurent (2004), Chiou & Lin (2006), Pérignon & Smith (2008), Komunjer (2013) et McNeil et al. (2015), McMillan & Speight (2007)). Cependant, si depuis longtemps on considère que l'ExpectedShortfall (ES) est une mesure "cohérente" du risque de marché (Artzner et al. 1999), en revanche, contrairement à la VaR, la littérature contient relativement peu de méthode d'évaluation de l'ES.Cela peut être expliqué par le fait que depuisl'émergence de la VaRcomme étant la mesurestandard du risque de marchérecommandée par les autorités réglementaires, les travaux de recherche se focalisent plus sur l'évaluation de la VaRau détriment de l'évaluation de l'ES dont l'intérêt réglementaire n'est que récent.Dans la littérature financière, il existe peu d'articles comparant les méthodes d'évaluation du risque de marché par la Value-at-Risk (VaR) et l'ExpectedShortfallES.Basak et Shapiro (2001) montrent qu'en cas de perte importante, l'évaluation et la gestion du risque via l'utilisation de l'ES conduisent à des pertes moins importantes que la VaR.Inui et Kijima (2005) développent des arguments théoriques en faveur de l'utilisation de l'ES au détriment de la VaR.Yamai et Yoshiba (2005) font une comparaison pratique entre VaR et ES, leurs conclusions indiquent quela VaR sous-estimeles pertes extrêmes par rapport à l'ES. Taylor (2008) proposeune nouvelle méthode économétri que appelée "exponentially weighted quantile regression" pour estimerl'Es. Pour l'auteur, la nouvelle méthode d'évaluation de l'ESsuperforme la VaR.Angelidis et Degiannakis (2007) ont utilisé une famille des modèles GARCH pour évaluer laVaRet ESde l'indice S & P 500. Les auteurs trouvent que les modèles APARCH et EGARCH ont donnéde meilleures prévisions. ALOUI et al (2015) ont étudié la performance de la VaR et l'ES via les modèles GARCH asymétriques et les modèles

GARCH à mémoire longue sur les marchés boursiers des pays de golf. Leurs résultats révèlent que le modèle de volatilité FIAPARCH est le mieux adapté à l'estimation de la VaR et I'ES.

## III. MÉThodologiE DE RECherche

### a) Value-at-Risk (VaR)

La méthodeVaR représente un niveau de perte Lqui ne sera dépassé durant une période temporelle qu'avec un certain degré de confiance α. La Value-at-Risk (VaR) paramétrique, pour une durée tet au seuil de probabilité α, est définie comme (Jorion 2006):

$$

\mathrm {P} [ L \leq V a R _ {\alpha} ] = \alpha

$$

En admettant que la distribution des rendements suive une loi normale, la VaR peut s'écrire de la manière suivante:

$$

V a R _ {\alpha} = N ^ {- 1} (\alpha) \sqrt {h _ {t}}

$$

Avec Nla fonction de distribution cumulative normale, $N ^ { - 1 } ( \alpha )$ le quantile de la loi normale et $h _ { t }$ La variance conditionnelle des rendements.

) Expected Shortfall (ES)

Expected Shortfall (ES), appelée également la ConditionalValue-at-Risk (CVaR), a été proposé pour la première fois par Artzner et. al.(1997). Elle est définie comme l'espérance conditionnelle des pertes au-delà du niveau de la VaR.ExpectedShortfall (ES) paramétrique au seuil de probabilitéα, est défini comme:

$$

E S _ {\alpha} = \frac {\Phi [ N ^ {- 1} (\alpha) ]}{1 - \alpha} \sqrt {h _ {t}}

$$

Où Φest la fonction de densité de probabilité, $N ^ { - 1 }$ a fonction de répartition inverse d'une loi normale et $h _ { t }$ La variance conditionnelle des rendements.

Dans le cas d'un portefeuille de n actifs, la volatilité deportefeuille est exprimée par la formule suivante $\sqrt { W ^ { T } H _ { t } W }$ où $W = \left[ w _ { 1, t }, w _ { 2, t }, \dots, w _ { n, t } \right]$ est levecteur des poids de chaque actif du portefeuille et $H _ { t }$ la matrice variance covariance conditionnelle.

### c) Modèles de la volatilité multivariés

Définition 1: Le modèle EWMA Covariance de RiskMetricsspécifie la covariance conditionnelle de la manière suivante:

$$

H _ { t } = \lambda H _ { t - 1 } + (1 - \lambda) r _ { t - 1 } r _ { t - 1 } ^ { \prime }

$$

Avec le $r _ { t }$ le processus des rendements.Le coefficient $\lambda$ fixé par le système RiskMetricsà 0.94 pour les données journalières.

Définition 2: Le modèle CCC de Bollerslev (1990) définitla matrice variance-covariance par l'équation suivante:

$$

H _ {i, j, t} = \rho_ {i, j} \sqrt {H _ {i , i , t} H _ {j , j , t}}

$$

La notation matricielle est:

$$

H _ {t} = D _ {t} R D _ {t}

$$

Avec D_tla matrice diagonale des volatilités conditionnelles et $R = \rho _ { i, j }$ la matrice descorrélations conditionnelles constantes.L'hypothèse fondamentale du modèle CCC est que les corrélations conditionnelles sont constantes dans le temps.

Définition 3: Le modèle DCC de Engle (2002) définit la matrice de corrélation conditionnelle dynamique R tcomme:

$$

H _ {t} = D _ {t} R _ {t} D _ {t}

$$

$$

R _ {t} = d i a g \{Q _ {t} \} ^ {- 1 / 2} Q _ {t} d i a g \{Q _ {t} \} ^ {- 1 / 2}

$$

Où la matrice quasi-corrélation $Q _ { t }$ de dimension $N \times N$ est spécifiée de la manière suivante:

$$

Q _ {t} = (1 - \alpha - \beta) \bar {Q} + \alpha z _ {t - 1} z _ {t - 1} ^ {\prime} + \beta Q _ {t - 1}

$$

Avec $z _ { i t } = \varepsilon _ { i t } \mathord { \left/ { \vphantom { \sum _ { i t } } } \right. \kern - delimiterspace } \sqrt { h _ { i i t } }$ les résidus standardisés, $\overline { { \boldsymbol { Q } } }$ la matrice covariance inconditionnelle des $z _ { t }$ et $\alpha$, $\beta$ les paramètres du modèle à estimer soit positive définitivement et que $\left( 1 - \alpha - \beta \right) > 0$.

Définition 4: Le modèle ADCC de Cappiello, Engle et Sheppard (2006) prendre en considération le phénomène de l'asymétrie dans le modèle DCC en permettant à la dynamique de la corrélation de réagir aux chocs négatifs et positifs des rendements financiers.

Dans le modèle ADCC, $Q _ { t }$ est spécifiée de la manière suivante:

$$

Q_{t} = (1 - \alpha - \beta)\bar{Q} - \gamma\bar{N} + \alpha z_{t-1} z_{t-1}^\prime + \gamma \eta_{t-1} \eta_{t-1}^\prime + \beta Q_{t-1} \eta_{t} = \min\left[ z_{t}, 0 \right]

$$

Avec le coefficient γ exprime l'asymétrie dans la corrélation qui caractérisel'effet d'un choc négatif sur la corrélation conditionnelle et $\overline { { N } }$ la matrice de covariance inconditionnelle de $\eta _ { t }$.

La méthode utilisée pour estimer les paramètres des modèles est celle de quasi-maximum de vraisemblance (QMLE).

### d)Backtesting Value at Risk

Traffic Light Test (TL test)

Le Traffic Light test (TL test), imposé par le comité de Bâle (1996) dans le cadre de la procédure de backtesting devalidation du modèleinterne, repose sur le calcul dunombre « exceptions » en fonction de trois zones de différentes couleurspour la validation du modèle interne:

- Les modèles de green zone qui affichentunnombre d'exceptionsinférieur à 4ne remettent en cause ni la qualité ni la précision du modèle.

- Les modèles de yellow zonequi affichent unnombre d'exception entre 5 et 9 suscitent quelques interrogations sur leur qualité prédictive sans conclusion définitive.

- Les modèles de red zonequi affichent unnombre d'exceptionssupérieur ou égaleà 10 dont la qualité prédictive du modèle n'est pas validée par le régulateur. Dans ce cas la banquedevrait revoir son modèle d'évaluation du risque.

Test de Kupiec

Le test de couverture inconditionnelle de Kupiec (1995) est un test bilatéral basé sur le nombre des exceptions.Kupiec a introduit deux tests: Proportions Of Failures test (POF Test) et Time Until First Failure (TUFF Test).

Le POF test examine la fréquence despertes supérieures à la VaR. La statistique de POF test est la suivante:

$$

L R _ {P O F} = - 2 l o g \left(\frac {(1 - p) ^ {N - x} p ^ {x}}{\left(1 - \frac {x}{N}\right) ^ {N - x} \left(\frac {x}{N}\right) ^ {x}}\right)

$$

Avec x est le nombre des exceptions, Nest le nombre des observations et $\mathsf { p } { = } 1$ -VaR level. La statistique $L R _ { P O F }$ suit une loi Khi-deux à un degré de liberté. Le modèle VaRest considéré non-valider si $L R _ { P O F }$ dépasse une valeur critique.

Le test TUFF (Time Until First Failure)mesure le tempsnécoulé pour que la première exception se produise. La statistique du test est:

$$

L R _ {T U F F} = - 2 l o g \left(\frac {p (1 - p) ^ {n - 1}}{\left(\frac {1}{n}\right) \left(1 - \frac {1}{N}\right) ^ {n - 1}}\right)

$$

La statistique $L R _ { T U F F }$ suit une loi Khi-deux à un degré de liberté. Si la statistique de test est inferieur à la valeur critique, le modèle est accepté et, dans le cas contraire, le modèle est rejeté.

#### Christoffersen test

Le test de Christoffersen (1998) mesure l'indépendance des différentes exceptions du modèle VaR adopté. La statistique de ConditionalCoverage Independence test de Christoffersen $L R _ { C C I }$ est:

$$

L R _ {C C I} = - 2 l o g \left(\frac {(1 - \pi) ^ {n _ {0 0} + n _ {1 0}} \pi^ {n _ {0 1} + n _ {1 1}}}{(1 - \pi_ {0}) ^ {n _ {0 0}} \pi_ {0} ^ {n _ {0 1}} (1 - \pi_ {1}) ^ {n _ {1 0}} \pi_ {1} ^ {n _ {1 1}}}\right)

$$

Avec πla proportion des exceptions observées, $\pi _ { 0 }$ la proportion des exceptions qui suivent un jour où aucune exception ne s'est produite et $\pi _ { 1 }$ la proportion des exceptions survenantaprès une précédente exception. $n _ { i j }$ le nombre des exceptions avec une valeur indicatrice i suivi par une valeur indicatrice j, pour $i, j = 0,1$. La fiabilité d'un modèle VaR est rejetée lorsque la statistique $L R _ { C C I }$ est supérieure à la valeur critique du khi-deux 1 degré de liberté.

Conditional Coverage test (CC test) de Christoffersen combine à la fois le test CCI de Christoffersen et le test POF de Kupiec pour tester la validité ou non des modèles VaR.La statistique de test est:

$$

L R _ {C C} = L R _ {P O F} + L R _ {C C I}

$$

La fiabilité d'un modèle VaR est rejetée lorsque la statistique $L R _ { C C }$ est supérieure à la valeur critique.

### e)Backtesting Expected Shortfall

Acerbi et Szekely (2014) ont proposé une nouvelle méthode statistique pour backtester l'expectedshortfall (ES). Ils définissent trois statistiques du test, chacune avec des hypothèses différentes. Les test $Z _ { 1 }$ ettest $Z _ { 2 }$ rendent l'estimation pratique de la statistique du test plus facile que les autres tests.

Les hypothèses des tests sont:

-: $H _ { 0 }$: $P _ { t } ^ { [ \alpha ] } = F _ { t } ^ { [ \alpha ] }$ Null: model is perfect

- $H _ { 1 }$: $E S _ { \alpha, t } ^ { F } > E S _ { \alpha, t } ^ { P }$ Alternative: ES underestimated

Avec $F _ { t }$ la distribution réelle (non observable) des séries de rendements qui est inconnue et $P _ { t }$ la distribution théorique des modèles utilisés. Les statistiques des tests $Z _ { 1 }$ et $Z _ { 2 }$ de Acerbi et Szekely (2014) sontlessuivantes:

Test 1: Testing ES after VaR

$$

Z _ {1} = \frac {\sum_ {t = 1} ^ {T} \frac {L I _ {t}}{E S _ {\alpha , t}}}{\sum_ {t = 1} ^ {T} I _ {t}} + 1

$$

Test 2: Testing ES Directly

$$

Z _ {2} = \sum_ {t = 1} ^ {T} \frac{L I _ {t}}{T \alpha E S _ {\alpha , t}} + 1

$$

Avec T le nombre des observations et L niveau de pertepour un portefeuille. Les statistiques $Z _ { 1 }$ et $Z _ { 2 }$ sontsensibles à la fois à l'ampleur et la fréquence des exceptions.

## IV. DOnnÉes & RÉsultats Empiriques

### a)Données et analyse statistique

Pour mener notre étude empirique, nous disposons un historique des séries des rendements d'un portefeuille composé de six indices boursiers. Il s'agit des données journalières sur un historique des prix de clôture des indices boursiers internationaux suivant: l'indice CAC 40 (CAC), l'indice DAX (DAX), l'indice S&P 500 (SP500), l'indice NASDAQ (CCMP), l'indice FTSE 100 (UKX) et l'indice Nikkei (NKY). L'ensemble des données sont exprimées en valeurs journalières. La période de l'étude s'étend du 05 janvier 2000 au 31 décembre 2012, soit 3330 observations. Ces cours étaient fournis par la base de données de Bloomberg. Les séries d'observations ont été ensuite transformées en séries des rendements logarithmiques, ce qui confère aux valeurs une structure de taux de variation.

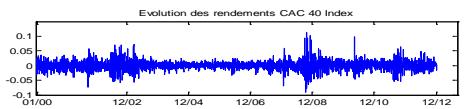

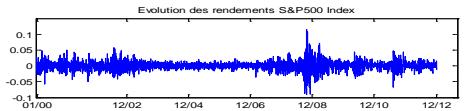

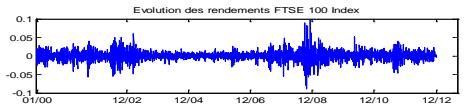

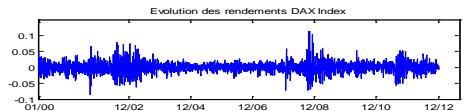

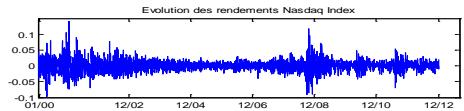

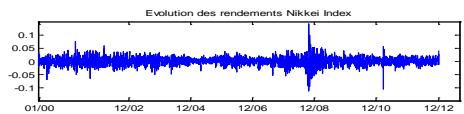

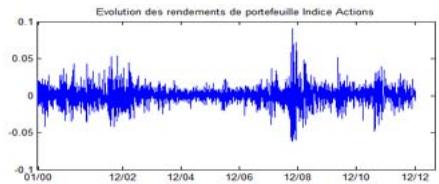

Les séries de rendement des indices boursiers d'actions et de portefeuille, figure (1), indiquent une forte volatilité surtout en période de crise des subprimes 2007-2008 et de crise des dettes souveraines 2009- 2012. On observe clairement une présence du phénomène «volatility clustering», phénomène constaté pour la première fois par Mandelbrot (1963), ce qui suggère une présence de la propriété d'hétéroscédasticité. Les valeurs n'exhibent pas de tendance. Elles semblent être stationnaires en moyenne mais pas en variance. Ce regroupement de volatilité est dû à la corrélation des rendements des actifs financiers. Ces intuitions sont vérifiées par l'application des tests statistiques.

Figure 1: Évolution des séries de rendements

L'analyse statistique des rendements, tableau (1), des actifs étudiés plaident pour une distribution empirique dite leptokurtique par rapport à une distribution gaussienne. En effet, le coefficient du kurtosis est très élevé pour toutes les séries des rendements. Cet excès de kurtosis signifie que les distributions présentent des queues plus épaisses que celles de la loi normale, elles sont dites leptokurtique. La valeur duskewness est différente de zéro ce qui est un signe de la présence des structures non linéaires dans le processus générateur des rendements, puisqu'on sait que les modèles linéaires gaussiens sont nécessairement symétriques.Ces résultats suggèrent que les distributions empiriques des rendements des différents actifs ne peuvent être assimilées à celles de la loi normale. Ce constat est confirmé par les tests d'adéquation de Jarque-Bera (test de normalité).

Tableau 1: Statistiques des rendements journaliers

<table><tr><td></td><td>CAC</td><td>DAX</td><td>SPX</td><td>CCMP</td><td>UKX</td><td>NKY</td><td>Index PF</td></tr><tr><td>Mean</td><td>-1.05E-05</td><td>1.74E-04</td><td>9.49E-05</td><td>8.04E-05</td><td>4.61E-05</td><td>-6.40E-05</td><td>5.35E-05</td></tr><tr><td>Volatility</td><td>0.0157</td><td>0.0162</td><td>0.0134</td><td>0.0178</td><td>0.0129</td><td>0.0153</td><td>0.01171</td></tr><tr><td>Min</td><td>-0.0904</td><td>-0.0849</td><td>-0.0903</td><td>-0.0967</td><td>-0.0885</td><td>-0.1141</td><td>-0.06153</td></tr><tr><td>Max</td><td>0.1118</td><td>0.1140</td><td>0.1158</td><td>0.1417</td><td>0.0984</td><td>0.1415</td><td>0.09038</td></tr><tr><td>Kurtosis</td><td>7.8571</td><td>7.4188</td><td>10.7313</td><td>8.1141</td><td>8.9764</td><td>10.1098</td><td>7.79064</td></tr><tr><td>Skewness</td><td>0.2029</td><td>0.1553</td><td>0.0344</td><td>0.2516</td><td>0.0178</td><td>-0.1870</td><td>0.04157</td></tr><tr><td>Jarque Bera</td><td>3296.1</td><td>2722.6</td><td>8294.1</td><td>3664</td><td>4956</td><td>7033.2</td><td>3185.3</td></tr></table>

Les résultats du test Lagrange Multiplicateur (LM test)d'effet ARCH, tableau(2), rejettent l'hypothèse nulle d'homoscédasticité en faveur de l'hypothèse alternative d'hétéroscédasticité ce qui signifie qu'il existe un effet ARCH pour toutes les séries de rendement. Ces résultats justifient la nécessité d'utiliser des modèles d'hétéroscédasticité conditionnelle. En outre, les résultats du test Engle et Ng (1993), tableau (2), montrent une présence évidente des effets asymétriques dans les séries des rendements des indices boursiers et de portefeuille. En effet, les résultats du negative size bias test $( b _ { 2 } )$ montrent que l'asymétrie négative est présente dans la réalité de toutes les séries des rendements. Cependant, les résultats du positive size bias test $( b _ { 3 } )$ ne sont pas significatifs, ce qui signifie que l'hypothèse de l'asymétrie positive n'est pas acceptée. Le test de Fisher confirme l'existence de l'effet de l'asymétrie de la volatilité conditionnelle.

Tableau 2: Test effet ARCH et Test effet asymétrie

<table><tr><td></td><td colspan="2">LM Test</td><td colspan="4">Test d'effet asymétrie</td></tr><tr><td></td><td>Stat</td><td>P-Value</td><td>b1(t-stat)</td><td>b2(t-stat)</td><td>b3(t-stat)</td><td>F-stat</td></tr><tr><td>CAC</td><td>537.2</td><td>0.0000</td><td>3.0492</td><td>-3.7301</td><td>0.9277</td><td>54.057</td></tr><tr><td>DAX</td><td>633.2</td><td>0.0000</td><td>4.1446</td><td>-4.6706</td><td>0.7961</td><td>57.065</td></tr><tr><td>SPX</td><td>916.2</td><td>0.0000</td><td>3.0911</td><td>-5.5602</td><td>1.2847</td><td>60.658</td></tr><tr><td>CCMP</td><td>617.2</td><td>0.0000</td><td>4.0306</td><td>-4.6473</td><td>1.4080</td><td>69.127</td></tr><tr><td>UKX</td><td>733.3</td><td>0.0000</td><td>2.5350</td><td>-4.4615</td><td>2.3159</td><td>76.277</td></tr><tr><td>NKY</td><td>954.2</td><td>0.0000</td><td>0.8466</td><td>-3.0429</td><td>1.2444</td><td>23.890</td></tr><tr><td>Equity Index PF</td><td>823.2</td><td>0.0000</td><td>3.8210</td><td>-3.6809</td><td>0.7867</td><td>52.860</td></tr></table>

Note: Résultats du test de Engle & Ng (1993). Pour les $b _ { j },$ on rejette l'hypothèse nulle de l'absence d'effet asymétrique si t-stat $> 1.96$ (en valeur absolue) et pour $F.$ -Stat on regarde la significativité de la statistique de Fisher.

Les quatre tests proposés par Engle et Ng (1993) sont les suivants:

Sign bias test $( b _ { \eta } )$

Negative size bias test $( b _ { 2 } )$:

Positive size bias test $( b _ { 3 } )$:

Joint test (F-stat):

Sur la base de ces résultats, nous déduisons qu'il est indispensable de prendre en compte les faits stylisés des séries de rendementsdans l'évaluation de la VaR et l'ES du marché en tenant compte des modèles dynamiques de la volatilité et de la corrélation.

### b) Résultats empiriques et discussion

Lesrésultatsd' estimation des paramètres des modèlesprésentés dans le tableau (3) montrent unepersistance dans l'évolution de lamatrice variancecovariance et de la corrélation des indices boursiers. En

$$

\hat{\varepsilon}_{t}^{2} = a_{1} + b_{1} S_{t-1}^{-} + e_{t}

$$

$$

\hat{\varepsilon}_{t}^{2} = a_{2} + b_{2} S_{t-1}^{-} \hat{\varepsilon}_{t-1} + e_{t}

$$

$$

\hat{\varepsilon}_{t}^{2} = a_{3} + b_{3} S_{t-1}^{+} \hat{\varepsilon}_{t-1} + e_{t}

$$

$$

\hat{\varepsilon}_{t}^{2} = a_{3} + c_{1} S_{t-1}^{-} + c_{2} S_{t-1}^{-} \hat{\varepsilon}_{t-1} + c_{3} S_{t-1}^{+} \hat{\varepsilon}_{t} + e_{t}

$$

effet, plus le paramètre (β) qui mesure le degré d'inertie est proche de 1, plus les effets des chocs persistent dans l'évolution de la corrélation.Nous constatons que $\alpha + \beta$ est assez proche de 1 ce qui montre que la volatility clustering et le caractère leptokurtique des distributions empiriques des rendements du portefeuille sont des phénomènes omniprésents. En outre, le coefficient d'asymétrie γ du modèle ADCC-TGARCH est positif, ce qui signifie que la corrélation augmente plus en réaction à la baisse des marchés qu'à la hausse.

Tableau 3: Résultats d'estimation des paramètres des modèles

<table><tr><td>Paramètres</td><td>ADCC (1,1,1)</td><td>DCC (1.1)</td><td>EWMA</td></tr><tr><td>α</td><td>0.0144</td><td>0.0162</td><td>0.06</td></tr><tr><td>β</td><td>0.9710</td><td>0.9785</td><td>0.94</td></tr><tr><td>γ</td><td>0.0122</td><td></td><td></td></tr></table>

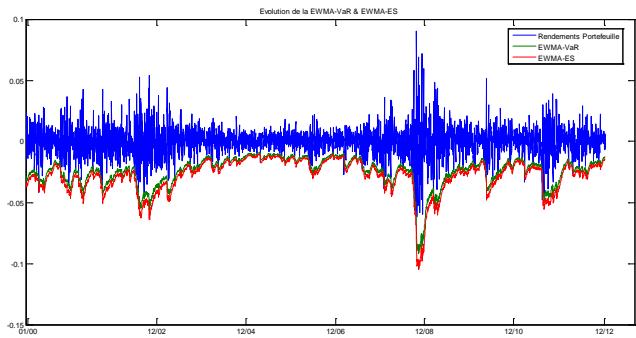

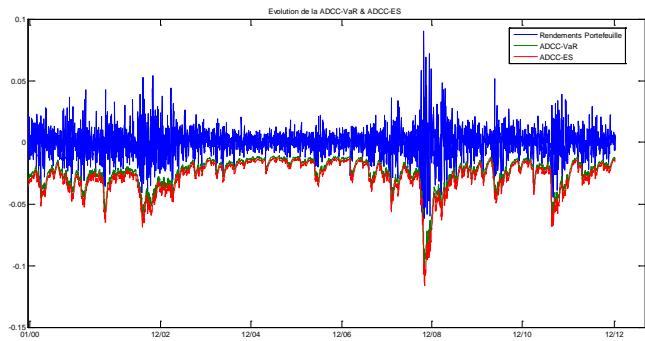

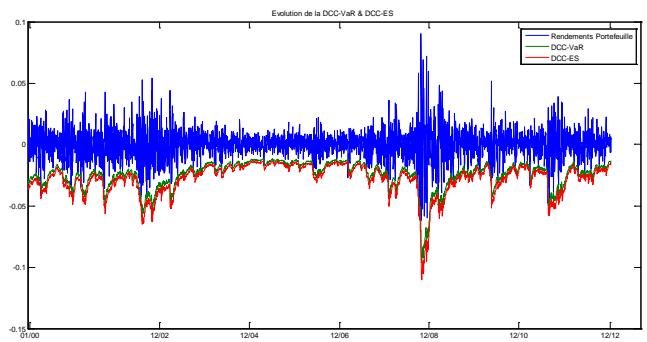

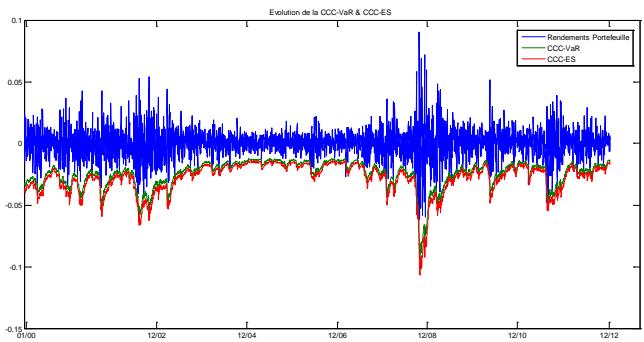

En appuyant sur les paramètres estimés cidessus, nous calculons la VaR et ES du portefeuille. Dans la figure (2) sont reportées les évolutions respectives des prévisions de la VaR et de l'ES journalière à $99\%$ comparés aux rendements réels de portefeuille.

Figure 2: P&L, VaR et ES du portefeuille

Pour tester la fiabilité des mesures du risque de marché estimées, nous utilisons les méthodes de backesting présentées ci-dessustelles que TL test, POF et TUFF Tests de Kupiec et CCI et CC tests de Christoffersen. Nous testons la qualité prédictive des modèles sur une fenêtre de temps de 250 jours ouvrables représentantla période 2007-2008.Période caractérisée par la crise de subprime où la volatilité des marchés financiers a enregistré un record historique jamais vu(le VIX et le V2X ont réalisé un record historique de plus de $80\%$ ), ainsi que sur une fenêtre de 750 jours ouvrables représentantla période début 2010- fin 2012. Période caractérisée par la crisedes dettes souveraines en Europe.Chaque modèle de risque est calculé pour troisniveaux de risque: $95\%$, $97.5\%$ et $99\%$.

Les résultats de TL test, présentés dans les tableaux (4.1, 4.2 et 4.3), montrent que tous les modèles de mesure de la VaRà $99\%$ fournissent un nombre d'exceptions qui fait partie des zones de validation du modèle interne, soit de yellow zone ou de green zone, avec une nette surperformance du modèle ADCC-VaR qui affiche un nombre réduit des violationsde la VaR, 5 pour $\mathtt { T } = 250$ et 17 pour $\mathtt { T } \mathtt { = } 750$, ce qui signifie que ce modèle encaisse bien le choc de volatilité de marché surtout en période des crises par rapport aux autres modèles de VaR.L'unique exception sont les modèles EWMA-VaR et CCC-VaRau seuil de $99\%$ pour une période dubacktest de 750 jours ouvrables qui sont rejetés par le TL test puisqu'elles font partie de la zone rouge, de point de vue du régulateur, les modèles est rejeté et l'institution financière devrait revoir son modèle d'évaluation du risque ou utiliser l'approche standard de calcul des fonds propres exigés pour couvrir le risque de marché.

Tableau 4.1: Résultats des Traffic Light Test pour VaR à 99%

<table><tr><td rowspan="2"></td><td colspan="2">TL test</td><td colspan="2">Failures</td><td colspan="2">Prob</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>Yellow</td><td>Red</td><td>9</td><td>22</td><td>0.99975</td><td>1</td></tr><tr><td>CCC VaR</td><td>Yellow</td><td>Red</td><td>8</td><td>20</td><td>0.99894</td><td>0.99997</td></tr><tr><td>DCC VaR</td><td>Yellow</td><td>Yellow</td><td>8</td><td>18</td><td>0.99894</td><td>0.99972</td></tr><tr><td>ADCC VaR</td><td>Yellow</td><td>Yellow</td><td>5</td><td>17</td><td>0.95882</td><td>0.99926</td></tr></table>

Tableau 4.2: Résultats des Traffic Light Test pour VaR à 97.5%

<table><tr><td rowspan="2"></td><td colspan="2">TL test</td><td colspan="2">Failures</td><td colspan="2">Prob</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>Yellow</td><td>Yellow</td><td>14</td><td>29</td><td>0.99823</td><td>0.9908</td></tr><tr><td>CCC VaR</td><td>Yellow</td><td>Yellow</td><td>13</td><td>31</td><td>0.99544</td><td>0.99707</td></tr><tr><td>DCC VaR</td><td>Yellow</td><td>Yellow</td><td>13</td><td>29</td><td>0.99544</td><td>0.9908</td></tr><tr><td>ADCC VaR</td><td>Yellow</td><td>Yellow</td><td>12</td><td>29</td><td>0.989</td><td>0.9908</td></tr></table>

Tableau 4.3: Résultats des Traffic Light Test pour VaR à 95%

<table><tr><td rowspan="2"></td><td colspan="2">TL test</td><td colspan="2">Failures</td><td colspan="2">Prob</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>Yellow</td><td>Green</td><td>22</td><td>39</td><td>0.99611</td><td>0.63956</td></tr><tr><td>CCC VaR</td><td>Yellow</td><td>Green</td><td>18</td><td>42</td><td>0.95264</td><td>0.80111</td></tr><tr><td>DCC VaR</td><td>Yellow</td><td>Green</td><td>18</td><td>38</td><td>0.95264</td><td>0.5761</td></tr><tr><td>ADCC VaR</td><td>Yellow</td><td>Green</td><td>18</td><td>40</td><td>0.95264</td><td>0.69893</td></tr></table>

Les résultats du POF tests obtenus dans les tableaux (5.1, 5.2 et 5.3) sont différents des résultats de TL test. Ils montrent que seul l'emploi du modèle ADCC-VaR est validé. La statistique calculée duPOF tests est inférieureà la valeur critique de 3.842au seuil de $5\%$ et 6.63 au seuil de $1\%$ de seuil de tolérance ce qui signifie que la qualité prédictive du modèleADcC-VaRest bien vérifiée. Les autres modèles affichentde mauvais résultats, car la valeur critique au seuil de $5\%$ et même au seuil de $1\%$ étaitdépassée, ce qui met en évidencel'importance du choc de la volatilité sur le marché des actions.Pour le niveau de VaR à $97.5\%$, nous constatons que la validité de la qualité prédictive des mesures VaR n'est pas acceptée,quel quesoit le modèle du risque considéré. Toutes les statistiques calculées duPOF testsont supérieures à la valeur critique, ce qui signifie que la qualité prédictivedes modèles n'est pas vérifiée.En revanche, le test TUFF est accepté pratiquement pour tous des modèles de VaR au seuil de $5\%$ et $1\%. 11$ est important de prendre en considération quand le premier dépassement de la VaR a eu lieu. Néanmoins, le test TUFF seul n'est pas un indicateurde robustesse pour évaluer la qualité du modèle de VaR.

Par conséquent, en s'appuyant sur les résultats des POF tests et test TUFF, il semble que le modèle ADCC-VaR est le plus adapté pourrefléter le risque réel en cas de conditions extrêmes des marchés par rapport aux autresmodèles.En effet, la période de baktesting choisie pour le cas de $\mathtt { T } = 250$ représente la période la plus stressante del'histoire du capitalisme où la volatilité des marchés financiers a marqué des recordshistoriques jamais vus. Il est clair que dans ce type de conjoncture de marché, lesmodèles trouvent quelques difficultés à capturer tous les mouvements des marchés et malgréça, le modèle ADCC-VaR a montré une forte capacité à capturer les différents mouvementsdes marchés même dans des régimes de volatilité anormale.

Tableau 5.1: Résultats du test de Kupiec pour la VaR à $99\%$

<table><tr><td rowspan="2"></td><td colspan="2">LRPOF</td><td colspan="2">LRTUFF</td><td colspan="2">First failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>10.229</td><td>18.635</td><td>5.4315</td><td>6.4579</td><td>3</td><td>2</td></tr><tr><td>CCC VaR</td><td>7.7336</td><td>14.445</td><td>5.4315</td><td>6.4579</td><td>3</td><td>2</td></tr><tr><td>DCC VaR</td><td>7.7336</td><td>10.666</td><td>5.4315</td><td>6.4579</td><td>3</td><td>2</td></tr><tr><td>ADCC VaR</td><td>1.9568**</td><td>8.9446</td><td>3.5893**</td><td>6.4579</td><td>7</td><td>2</td></tr></table>

Tableau 5.2: Résultats du test de Kupiec pour la VaR à 97.5%

<table><tr><td rowspan="2"></td><td colspan="2">LRPOF</td><td colspan="2">LRTUFF</td><td colspan="2">First failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>7.3304</td><td>4.9383</td><td>3.6599</td><td>4.6558</td><td>3</td><td>2</td></tr><tr><td>CCC VaR</td><td>5.7302</td><td>6.8796</td><td>3.6599</td><td>4.6558</td><td>3</td><td>2</td></tr><tr><td>DCC VaR</td><td>5.7302</td><td>4.9383</td><td>3.6599</td><td>4.6558</td><td>3</td><td>2</td></tr><tr><td>ADCC VaR</td><td>4.2925**</td><td>4.9383**</td><td>3.6599**</td><td>4.6558**</td><td>3</td><td>2</td></tr></table>

Tableau 5.3: Résultats du test de Kupiec pour la VaR à $95\%$

<table><tr><td rowspan="2"></td><td colspan="2">LRPOF</td><td colspan="2">LRTUFF</td><td colspan="2">First failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>6.259</td><td>0.062376</td><td>2.3776</td><td>3.3215</td><td>3</td><td>2</td></tr><tr><td>CCC VaR</td><td>2.2555</td><td>0.54809</td><td>2.3776</td><td>3.3215</td><td>3</td><td>2</td></tr><tr><td>DCC VaR</td><td>2.2555</td><td>0.006988</td><td>2.3776</td><td>3.3215</td><td>3</td><td>2</td></tr><tr><td>ADCC VaR</td><td>2.2555**</td><td>0.17186**</td><td>2.3776**</td><td>3.3215**</td><td>3</td><td>2</td></tr></table>

Les résultats du test d'indépendance de couverture conditionnelle (CCl test), présentés dans le tableau (6), pour les différents modèles de mesure du risque de marché etpour tous les échantillons de backtesting indiquent que les violations sontsignificativement indépendantes. En effet, les statistiques $L R _ { C C I }$ sont inférieures à la valeur critique et pour un seuil de tolérance de $5\%$ et même au seuil de

$1\%$ cela signifie quel'hypothèse de clustering des dépassementsest rejetée et donc le modèle VaR considéré n'est passuffisamment sensible aux mouvements de marché. Les résultats du CCl test montrent une capacité des différents modèles considérés à capturer le regroupement desviolations de la VaRmême en phase de stress des marchés financiers. En revanche, les résultats du test de couverture conditionnelle (c test) sont plus compatibles avec les résultats obtenus par le POF test. En effet, la plupart des modèles de VaR sont rejetéspar le CC test. Une grande partie des statistiques calculées du $L R _ { C C }$ sont supérieuresà la valeur critique de la loi Khi-deux à $5\%$ (5.99) ce qui indique l'inefficacité prédictive des modèles de VaR; l'unique exception est le modèle ADCC-VaR.

Tableau 6.1: Résultats du test de Christoffersen pour la VaR à $99\%$

<table><tr><td rowspan="2"></td><td colspan="2">LRCCI</td><td colspan="2">LRCC</td><td colspan="2">Failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>0.67516</td><td>1.9896</td><td>10.904</td><td>20.625</td><td>9</td><td>22</td></tr><tr><td>CCC VaR</td><td>0.53122</td><td>0.34543</td><td>8.2648</td><td>14.79</td><td>8</td><td>20</td></tr><tr><td>DCC VaR</td><td>0.53122</td><td>0.57865</td><td>8.2648</td><td>11.245</td><td>8</td><td>18</td></tr><tr><td>ADCC VaR</td><td>0.20493</td><td>0.78969</td><td>2.1617</td><td>9.7343</td><td>5</td><td>17</td></tr></table>

Tableau 6.2: Résultats du test de Christoffersen pour la VaR à 97.5%

<table><tr><td rowspan="2"></td><td colspan="2">LRCCI</td><td colspan="2">LRCC</td><td colspan="2">Failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>1.6691</td><td>0.61174</td><td>8.9995</td><td>5.55</td><td>14</td><td>29</td></tr><tr><td>CCC VaR</td><td>1.4329</td><td>0.37736</td><td>7.1632</td><td>7.2569</td><td>13</td><td>31</td></tr><tr><td>DCC VaR</td><td>1.4329</td><td>0.61174</td><td>7.1632</td><td>5.55</td><td>13</td><td>29</td></tr><tr><td>ADCC VaR</td><td>1.2157</td><td>2.406</td><td>5.5082</td><td>7.3443</td><td>12</td><td>29</td></tr></table>

Tableau 6.3: Résultats du test de Christoffersen pour la VaR à $95\%$

<table><tr><td rowspan="2"></td><td colspan="2">LRCCI</td><td colspan="2">LRCC</td><td colspan="2">Failure</td></tr><tr><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>4.271</td><td>0.45546</td><td>10.53</td><td>0.51783</td><td>22</td><td>39</td></tr><tr><td>CCC VaR</td><td>2.808</td><td>0.18407</td><td>5.0636</td><td>0.73216</td><td>18</td><td>42</td></tr><tr><td>DCC VaR</td><td>2.808</td><td>0.57495</td><td>5.0636</td><td>0.58194</td><td>18</td><td>38</td></tr><tr><td>ADCC VaR</td><td>2.808</td><td>1.4823</td><td>5.0636</td><td>1.6542</td><td>18</td><td>40</td></tr></table>

L'évaluation du risque de marché parl'Expected Shortfall (ES) permet une meilleure prise en charge des faits stylisés des rendements des actifs financiers que la VaR puisqu'on raisonne en termes de la moyenne des quantiles et non pas en termes d'un quantile unique fixe comme la VaR. Ce constat implique que la valeur estimée de l'ES est systématiquement supérieure à la valeur estimée de la VaR ce que donne à l'ES un réelavantage par rapport à la VaR. En effet, les résultats des tests $Z _ { 1 }$ et $Z _ { 2 }$ du backtesting de l'ExpectedShortfall (ES), reportés dans les tableaux (7.1 et 7.2), montrent une surperformance des modèles d'ES par rapport aux modèles VaR. Le caractère conservateur de la mesure ES combiné avec l'utilisation des modèles de la volatilité multivariés dynamiques ont permet de produire de meilleurs résultats que les mesures VaR présentées cidessus. La validité de la qualité prédictive de tous les modèles est acceptée et ceci quel quesoit le niveau du risque considéré $( 95\%$, $97.5\%$ et $99\%$. Toutes les statistiques calculées destests $Z _ { 1 }$ et $Z _ { 2 }$ de Acerbi et Szekely (2014) sont supérieures à la valeur critique pour un seuil de tolérancede $5\%$ ce qui signifie que la qualité prédictivedes modèles est acceptée. L'utilisation des modèles de la volatilité multivariés produit des mesures robustes de l'ES. En revanche, le fait que les statistiques destests $Z _ { 1 }$ et $Z _ { 2 }$ valident toutes les mesures du risque utilisées, nous nous interrogeons sur le faite que les modèles d'ES adoptésentraînent une surestimation du risque du marché en période de stress des marchés financiers.

Enfin, nous constatons que la procédure du backtesting recommandée par le régulateur dans le cadre de FRTB, basée sur l'utilisation de la VaR et non pas sur l'utilisation de l'ES, pénalise la mesure du risque recommandé par FRTB puisque les procédures de backesting de la VaR et l'ES adoptés dans notre étude empirique affichent des résultats très différents.

Tableau 7.1: Résultats du test $Z _ { 1 }$ pour Expected Shortfall pour $\mathtt { T } = 250$ et $\mathtt { T } \mathtt { = } 750$

<table><tr><td></td><td colspan="2">ES 95%</td><td colspan="2">ES 97.5%</td><td colspan="2">ES 99%</td></tr><tr><td></td><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>-0.07858 (-32.438)</td><td>-0.18635 (-45.451)</td><td>-0.071474 (-28.651)</td><td>-0.13943 (-40.111)</td><td>-0.031892 (-25.065)</td><td>-0.057719 (-35.086)</td></tr><tr><td>CCC VaR</td><td>-0.12186 (-32.352)</td><td>-0.14755 (-45.837)</td><td>-0.072687 (-28.614)</td><td>-0.10207 (-40.502)</td><td>-0.047535 (-25.103)</td><td>-0.047778 (-35.481)</td></tr><tr><td>DCC VaR</td><td>-0.11478 (-32.404)</td><td>-0.14426 (-44.486)</td><td>-0.067943 (-28.509)</td><td>-0.08419 (-39.199)</td><td>-0.040087 (-25.057)</td><td>-0.032349 (-34.279)</td></tr><tr><td>ADCC VaR</td><td>-0.073021 (-32.218)</td><td>-0.12119 (-47.187)</td><td>-0.045749 (-28.456)</td><td>-0.07025 (-41.608)</td><td>-0.055153 (-24.92)</td><td>-0.035417 (-36.512)</td></tr></table>

Tableau 7.2: Résultats du test $Z _ { 2 }$ pour Expected Shortfall pour $\mathtt { T } = 250$ et $\mathtt { T } \mathtt { = } 750$

<table><tr><td></td><td colspan="2">ES 95%</td><td colspan="2">ES 97.5%</td><td colspan="2">ES 99%</td></tr><tr><td></td><td>250</td><td>750</td><td>250</td><td>750</td><td>250</td><td>750</td></tr><tr><td>EWMA VaR</td><td>-0.8983 (-336.86)</td><td>-0.2338 (-466.25)</td><td>-1.4001 (-594.06)</td><td>-0.76231 (-826.07)</td><td>-2.7148 (-1305.5)</td><td>-2.1026 (-1807.9)</td></tr><tr><td>CCC VaR</td><td>-0.61547 (-337.94)</td><td>-0.28525 (-472.23)</td><td>-1.2312 (-595.64)</td><td>-0.82208 (-834.86)</td><td>-2.3521 (-1309.3)</td><td>-1.7941 (-1830.9)</td></tr><tr><td>DCC VaR</td><td>-0.60529 (-337.01)</td><td>-0.15951 (-457.87)</td><td>-1.2213 (-594.07)</td><td>-0.67688 (-807.36)</td><td>-2.3283 (-1303.6)</td><td>-1.4776 (-1768.7)</td></tr><tr><td>ADCC VaR</td><td>-0.54515 (-335.98)</td><td>-0.19594 (-485.01)</td><td>-1.0078 (-591.17)</td><td>-0.65532 (-855.46)</td><td>-1.1103 (-1302.1)</td><td>-1.3469 (-1881.2)</td></tr></table>

## V. COnclusioN

Ce travail nous a permis de mettre en évidence, de point de vue théorique et empirique, l'importance d'utiliser les méthodes Value-at-Risk (VaR) et Expected Shortfall (ES) dans l'évaluation du risque bancaire en vue d'examiner leurs performances prédictives.

Dans un premier temps, à travers une étude empirique sur des données réellesetunepériode de tempsqui prend en considérationla crise des subprimes 2007-2008 et la crise des dettes souveraines 2009-2012, nous avons montré que des phénomènes tels que volatility clustering, caractère leptokurtique, excès de kurtosis et asymétrie de la volatilité des distributions empiriques des rendements, sont des phenomena somniprésents dans la réalité du mouvement des marchés financiers. Afin de prendre en considération ces phénomènes dans l'évaluation de la VaR et ES, nous avons utilisédes modèles de volatilité multivariéstels que les modèles EWMA, CCC, DCC et ADCC. Les résultats obtenus montrent une capacité des modèles VaR et ES estimés à capturer les différentes caractéristiques empiriques et statistiques observées dans l'évolutiondes marchés financiers. En effet, nous avons montréune grande capacité de ces modèles à s'adapter plus rapidement aux changements des conditions des marchés. En revanche, nous avonsconstaté que certaines spécifications montrent plus devariations que d'autres en termes d'encaissement des chocs des marchés, en particulier leschocs négatifs.Cette intuition afait l'objet d'une vérification empirique par une procédure de backtesting de la VaR et de l'ES.L'ensemble de ces procédures nous a permis de tester l'aptitude des modèlesVaR et ESà quantifier correctement les pertes maximales potentielles.

En mettant en place des procédures de backtesting, les résultats obtenus montrent que l'évaluation du risque de marché par l'Expected Shortfall (ES) permet une meilleure prise en charge des faits stylisés des marchés financiers que la VaR. Ce constat implique que les valeurs estimées de l'Expected Shortfall sont systématiquement supérieuresaux valeurs estiméespar la VaR ce que donne à l'Expected Shortfall un réelavantage par rapport à la VaR. En effet, les résultats du backtesting de l'Expected Shortfall (ES) montrent une surperformance des modèles l'Expected Shortfall par rapport aux modèles VaR. Le caractère conservateur de la mesure Expected Shortfall combiné avec l'utilisation des modèles de la volatilité multivariés dynamiques ont permet de produire des meilleurs résultats que les mesures VaR.L'utilisation des modèles de la volatilité multivariés produit des mesures de robustes de l'Expected Shortfall.

Un autre résultat important dégagé est celui de la non-compatibilité de la méthode de backtesting imposée par le régulateur avec la méthode d'évaluation du risque de marché. En effet, nous avonsconstaté que la procédure du backtesting recommandée par le régulateur dans le cadre FRTB, basée sur l'utilisation de la VaR pénalise la mesure du risque recommandé (l'Expected Shortfall).

Generating HTML Viewer...

References

22 Cites in Article

Unknown Title.

(2014). les tableaux montrent les valeurs statistiques des tests 𝑍𝑍 1 et 𝑍𝑍 2 de Acerbi et Szekely.

Philippe Artzner,Freddy Delbaen,Jean‐marc Eber,David Heath (1999). Coherent Measures of Risk.

C Acerbi,D Tasche (2002). Expected Shortfall: A natural coherent alternative to Valueat Risk.

Torben Andersen,Tim Bollerslev,Peter Christoffersen,Francis Diebold (2005). Practical Volatility and Correlation Modeling for Financial Market Risk Management.

Timotheos Angelidis,Stavros Degiannakis (2007). Backtesting VaR Models: An Expected Shortfall Approach.

C Acerbi,B Szekely (2014). Backtesting expected shortfall.

Chaker Aloui,Hela Hamida (2015). Modelling and forecasting value at risk and expected shortfall for GCC stock markets: Do long memory, structural breaks, asymmetry, and fat-tails matter?.

No ethics committee approval was required for this article type.

Data Availability

Not applicable for this article.

How to Cite This Article

Mouallim Isam. 2026. \u201cEvaluation of Value-at-Risk and Expected Shortfall Measures in Market Risk Management\u201d. Global Journal of Management and Business Research - C: Finance GJMBR-C Volume 22 (GJMBR Volume 22 Issue C3).

Explore published articles in an immersive Augmented Reality environment. Our platform converts research papers into interactive 3D books, allowing readers to view and interact with content using AR and VR compatible devices.

Your published article is automatically converted into a realistic 3D book. Flip through pages and read research papers in a more engaging and interactive format.

Our website is actively being updated, and changes may occur frequently. Please clear your browser cache if needed. For feedback or error reporting, please email [email protected]

Thank you for connecting with us. We will respond to you shortly.